成果概要

誰もが自在に活躍できるアバター共生社会の実現[4] CA協調連携の研究開発

2024年度までの進捗状況

1. 概要

本研究開発項目は、複数サイバネティク・アバター(CA)の同時遠隔操作・連携制御技術(自在CA制御)の基盤研究開発を担っています。この研究開発項目の達成により、1人の操作者が同時に複数のCAを操作することが可能となり、プロジェクトの目指すアバター共生社会の実現、ムーンショット目標で目指す空間・時間制約からの解放に貢献します。

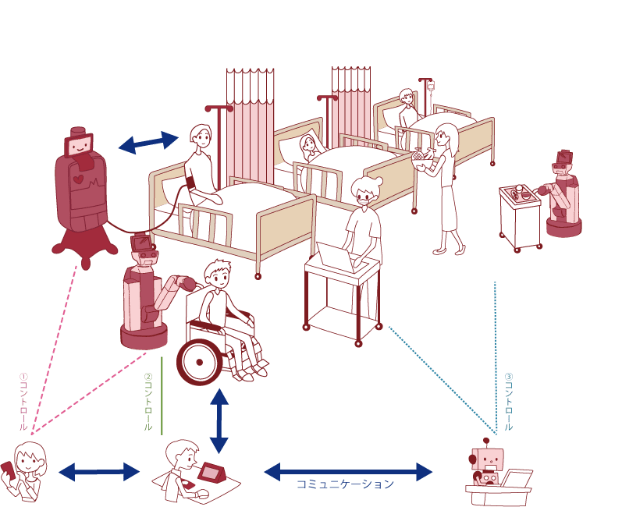

この達成に向けてはタスクや環境に応じて操作者の意図を理解しながら働く複数CAを利用する技術開発が課題となります。本研究開発項目ではまず、CAが連携する生活環境や病室環境を再現し、そこで活躍する半自律化CAを、遠隔操作から自律化する自律化CA技術をベースに試作します(図1)。そして、複数CAからなる半自律連携制御システムの操作インタフェースをBrain-machine Interface (BMI)を含め開発します。

2. これまでの主な成果

(1)CA連携環境実証:大阪・うめきた「みらい創発hive」において2名のオペレータ(操縦+命令+対話)によって、10台以上の異種生活物理支援CAを操作し、5拠点(在宅医療、病院、家庭、オフィス、商業施設)を模擬した遠隔監視に接続し、統合実証実験を実施。複数CAが各拠点で連携・分担・自律補完的にタスクを遂行することを確認しました。

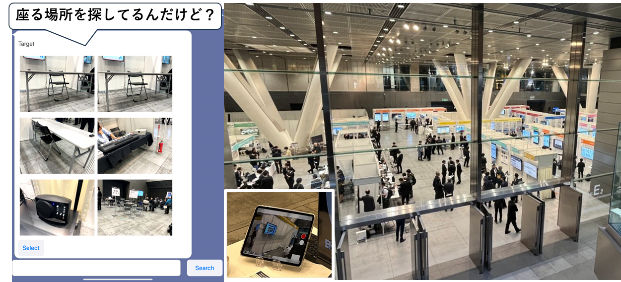

(2)マニピュレーションCA自律化:オペレータが対象物体を自在に選択可能な深層模倣学習技術を開発。単なるプリセット操作ではなく、リアルタイムに変化する環境や対象物に対応する柔軟な操作が可能にしました(図2)。視覚・言語情報を統合した汎用操作基盤への発展を見込みます。

(3)拡張現実CAインタフェース:拡張現実技術を用いた未来視テレオペレーションを実現しました。マニピュレーション・ナビゲーション行動の未来予測をXR上で可視化し、操作者に直感的な操作環境を提供しました(図3)。

(4)CA空間・環境理解技術:実世界検索エンジンの改良と大規模実証を実施した。100,000平米以上の空間に対応し、言語ベースで対象を即時に検索可能にしました。代表例としてドバイモールにおける大規模実証を実施(図4)。スマートフォン版の実世界クローラを新たに構築し、社会展開に向けた実空間でのCA支援性能を検証しました。

(5) 半自律ハンド:近接覚センサ搭載の自在ハンドを開発し、“なじむ”把持制御(対象物の形状や動きに応じて把持姿勢が事前調整される)により、CAの把持操作の自然性と安定性を大幅に向上させました(図5)。

3. 今後の展開

今後は、さらなる多数のCAの同時遠隔操作と自律連携の高度化に挑戦します。これまでに開発してきた各種要素技術(大規模言語モデル(LLM)によるタスク分割、近接覚自在ハンド、XRテレオペなど)を統合実証システムに組み込み、CA同士が意図調停・役割分担を行いながら連携動作する仕組みを構築します。また、物理支援CAの自律化を推進し、一人の操作者が自律・半自律・共有自律・遠隔操作を柔軟に組み合わせて多様なCAを活用可能な統合システムを実現します。社会実装に向けた公開デモや運用検証を推進します。