エッセイ #5「専門家と一般市民はAIトリアージへの期待がどのくらい違うのか?」

言説化の取り組み | 2022年10月31日

- 中川裕志 理化学研究所 革新知能統合研究センター 社会における人工知能研究グループ チームリーダー(AI倫理、AIエージェント、プライバシー、デジタル遺産の法的問題)

新型コロナウイルス感染症 (COVID-19) が猛威を振るった時期、医療機関がひっ迫し、多数の入院を必要とする感染者のすべてを病院で受け入れることができず、現場は入院できる患者を選別する作業、いわゆる「トリアージ」を行うことを余儀なくされた。今回のCOVID-19に関するトリアージは、保健所などの現場で、職員がこれまでの経験に基づいて行うことが多かったかもしれないが、将来のパンデミック時には、入院すべき患者に優先順位をつけるトリアージをAIが行うことも考えられるだろう。パンデミックでなくても、重症患者が必要とする特殊な医療設備においては、利用患者の選別が必要だし、慢性的に不足している臓器移植の順位付けにもトリアージが必要となる。

AIを用いたトリアージの利用の可否は倫理的な問題として議論するべきだと思われるが、今の人々がどのように考えているかを知っておくことは、このような議論に有益であろう。そこで、医師・看護師などの医療専門家544人、一般市民1,079人を対象に、AIによるトリアージの可否に関する意識を問う社会調査[1]を行った。

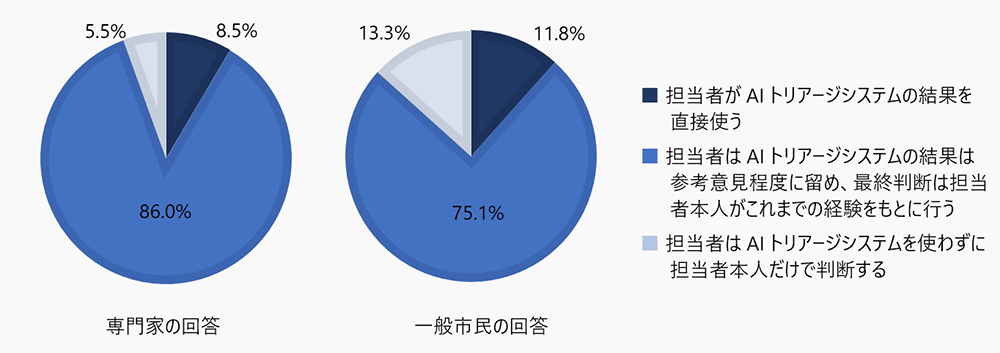

まず、AIトリアージシステムの使い方に関する調査結果を紹介しよう。医療専門家、一般市民それぞれに、3つの選択肢から1つを選んでもらった。

意外なことに、一般市民は専門家よりも「AIトリアージシステムの結果を直接使う」ことを肯定する人が多いことが分かった。この結果は、一般市民がAIに対する強い期待を持つことの表れであろう。同時に、AIトリアージシステムを使うべきではないという市民の意見も、専門家の2.5倍近く存在する。これは、AIは得体がしれない、言い換えればブラックボックスであり、素直には信用できないという市民がまだまだ多いことを示している。一方で、専門家は、AIトリアージシステムの結果を参考にしつつも、最終的な判断は自分で行うとしていることが読み取れる。これは専門家のプライドの表れであろうか。

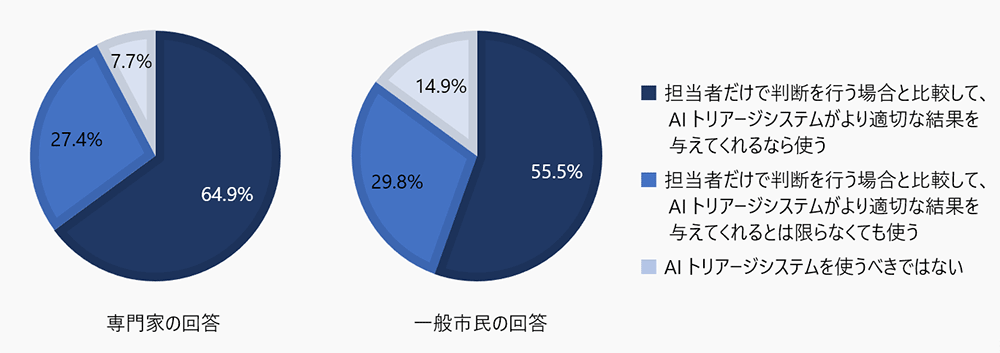

次に、医療担当者の判断とAIトリアージシステムの性能を勘案した場合にAIトリアージシステムの使用可否判断について質問し、以下の3つの選択肢から選んでもらった。

専門家も一般市民も「AIトリアージシステムがより適切な結果を与えてくれるなら使う」の選択肢を選んだ割合が高いのは当然であるが、専門家のほうが10%近く多いのは、やはり専門家はAIトリアージシステムの性能に対するエビデンスを要求する考え方をするからであろう。専門家としては当然のことと思われる。2つめの「AIトリアージシステムがより適切な結果を与えてくれるとは限らなくても使う」の選択肢について、一般市民が専門家より若干割合が高いのは意外であるが、市民のほうが、AIの内容の理解が薄いが先行的に期待してしまっている可能性があるのかもしれない。その裏返しとして、3つめの「使うべきでない」は一般市民が専門家の2倍に上るが、市民のAIへの理解の薄さが、AIを信用しない、できない、という心理に結びついているからではないかと考えられる。これらは、前述の調査結果とも整合している。

以上をまとめてみると、専門家はAIに関する理解が深いだけに過度の期待や拒否は少なく、かつAIを利用する場合はその性能に対するエビデンスに基づくという、専門家らしい態度がみられる。一般市民はAIについての内容の理解が専門家より浅いと思われ、結果として過度の期待や、感情的な拒否感を示す人が多くなっているのではないかという分析結果が見てとれる。

こういった事情に対処する方法のひとつとして、AIが出してきた結果に関してなぜそのような結果が得られたかを説明する「説明可能なAI」と呼ばれる技術が研究されているが、説明可能性が必ずしも市民の理解可能性まで達していない状況である。この問題をAI技術だけによって解決しようとするのではなく、すべての人がAIを利用できる市民のAIリテラシーの向上も併せて解決していこうという方向性が、「人間中心のAI社会原則」[2]でも提起されている。

今後、AIが社会生活の多くの場面で使われるようになると思われるが、この例にみられるような過度の期待や感情的な拒否感は避けたいところである。今回の調査結果をみると、専門家と一般市民においてAIについての見方に差はあるものの、その差は比較的小さなものだと思われる。したがって、一般の人々にもAIに関する基礎的なリテラシーをもってもらうことは十分に可能であろう。一方で、そのようなリテラシーの差異を踏まえた上でAIについての学びの機会を提供していくこと、すなわちAIの”Trust " (信頼性) について専門家/非専門家に関わらず真摯に対話を行い、AIの能力に関する知識をすべての人々が持てるようなアウトリーチ活動を行うことが、専門家として行うべき社会的役割のひとつであるという時代になっていると思う。

[1]JST-RISTEX「人と情報のエコシステム」研究開発領域「PATH-AI: 人間-AIエコシステムにおけるプライバシー、エージェンシー、トラストの文化を超えた実現方法」 (代表者: 中川裕志、グラント番号: JPMJRX19H2) 2022年度調査結果

[2]内閣府「人間中心のAI社会原則」 (2019年3月29日 統合イノベーション戦略推進会議)